小编:几天前,Nvidia再次创造了历史。 7月3日,NVIDIA市场价值短暂攀升至3.92万亿美元,超过苹果

几天前,Nvidia再次创造了历史。 7月3日,NVIDIA的市场价值提高了3.92万亿美元,超过了苹果以前的3.915万亿美元记录,该公司已成为具有市场价值的最高历史记录公司。人工智能计算能力的快速增长将这家GPU制造商推向了前所未有的高位。尤其是自2024年底以来,布莱克韦尔的平台销售业绩(既跃升为能源的表现和效率)都打破了世界以外的疑问。 NVIDIA创始人兼首席执行官Huang Renxun在最新的收入电话会议中说,仅在2025年第一季度,这个新平台贡献了NVIDIA数据收入的近70%。但是,随着NVIDIA市场成本及其混合物的增加,生态系统也出现了裂缝。最常见的例子是Nvidia -Openai的重要客户。 Openai Insider引用的信息几乎是NVIDIA市场成本,Openai说Openai使用Google的TPU芯片自由提供计算能力SU SU用于CHATGPT和其他产品的PPORT。 TPU服务器,照片/Google,即使Openai在随后的响应中故意降低了“转向”,并强调这是一项测试,并且“没有很大的收养计划”。但是对于曾经定义新AI时期的公司而言,即使是“测试”也足以触发高市场敏感性。同时,它还使第七代Google,Ironwood再次成为重点。这是一个专用的AI芯片,可定制用于识别场景。它不仅直接指向了布莱克韦尔(Blackwell)的每一个WAT,而且还表现出对成本和扩张费用的强烈吸引力。更重要的是,面对结构性挑战的真正使NVIDIA的原因是ASIC芯片营地,其强调“效率”而不是“通用”。诸如Google,Amazon和Meta之类的巨型云继续增加他们对自发加速器的投资,以避免NVIDIA GPU的高成本;虽然小脑和图形等初创公司re - 从芯片体系结构和系统设计的角度来定义“ AI特异性计算”,试图开发与GPU完全不同的技术路径。对于Nvidia而言,第一世界的宝座是不稳定的。 ASIC攻击成为NVIDIA的“主要问题”,以扩展整个文本

就像俗话说,谁知道一个人的最好的人通常是他的对手。

5月19日,NVLink Fusion是一种新的互连体系结构,被称为“合作平台的AI工程”。通过允许NVLINK芯片间互连(C2C)和模块的集成转移,第三方制造商可以将其自开发的加速器或CPU连接到由计算系统领导的NVIDIA。

与过去的NVLINK设计相比,Fusion的“似乎包括半开放态度,但本质仍然需要合作伙伴附加到NVIDIA Ecology Track。任何定制的芯片都应连接到NVIDIA产品,并且它只选择打开900GB/ 900GB//的界面s nvlink-c2c。 NVLINK融合似乎是表面上的开放态度,这实际上不仅仅是一种防御动作:

防御Ualink联盟。

照片/Ualink联盟

2024年10月,Ualink Alliance Co与AMD,Intel,Google,Meta,Microsoft,AWS,ATBP合作。

今年4月,Ualink发布了1.0标准互连,支持多达1,024个加速器节点,800GBPS带宽互连以及开放的内存 - 仪表协议,而不是仅此通信技术,而是针对“ de-nvidia”的系统布局。 NVIDIA对AI CHIP架构的相互关联比其他任何人都能理解:

真正应得的观看不是特定的制造商,而是整个ASIC营地开始摆脱GPU希望并试图重建硬件订单。

真正应得的观看不是特定的制造商,而是整个ASIC营地开始摆脱GPU希望并试图重建硬件订单。

与GPU的一般体系结构不同,SICS是针对特定活动定制的芯片,在AI期间,它们可以完全优化用于理解,培训和推动等主要计算路径。现在,在Microsoft,Meta和Amazon等巨人中实现了这一概念,并探索了从NVIDIA GPU平台到自我开发的AI ASIC芯片的过渡。

Google是最好的例子,TPU系列自发射以来已经在第七代Ironwood开发了,该系列是为识别任务而设计的,其性能直接超过了NVIDIA Blackwell的每瓦。 Openai研究人员认为,Ironwood的作用与GB200相当,甚至在X平台上稍好一些。更重要的是,TPU系列支持从训练到远见的大型双子座模型的巨大应用大小。

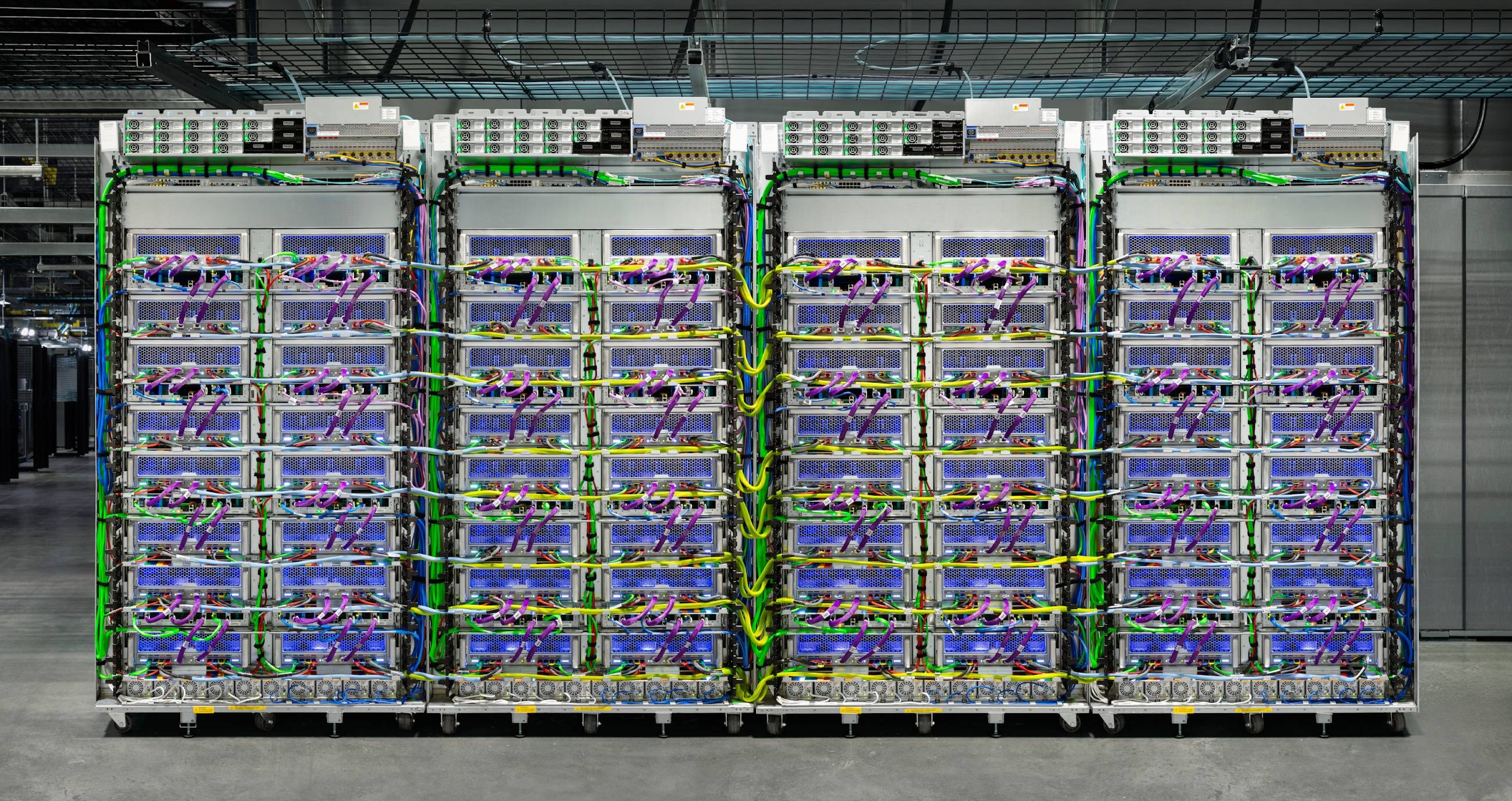

照片/Google

同时,除了其前竞争对手AMD外,包括Meta和AWS在内的MGA新芯片制造商还试图“赶上” Nvidia GPU。基于它的collMeta的第一个AIC芯片MTIA T-V1与Broadcom的灌溉已被宣布有可能超过Nvidia的下一代Rubin芯片的细节。 AWS根据与Marvell的合作推出了另一个版本的Trainiu。 M V3的发展有望在2026年产生质量。

根据野村证券较早发布的最新报告,2025年的Google TPU传输约为150万至200万,AWS Trainium和Phebentia约为140万至150万。到Meta和Microsoft开始大规模部署时,预计它将在2026年首次超过NVIDIA GPU(500万至600万)。

就初创企业而言,脑部是世界上最大的芯片的“独角兽”,它开发了世界上最大的芯片,并用晶圆 - 规模的引擎(WSE)领导了芯片芯片的不断变化的建筑,并在许多科学和科学研究的项目上实施了它。虽然服用GraphCore SOFTbank经历了曲折,它仍然坚持在网络处理(IPU)的体系结构中找到突破。诸如紧张和叛乱之类的新移民继续积累客户,并运送到AI推理和计算边缘等子区域。

世界上最大的芯片,图片/脑脑

Nvidia必须了解这一点,因此她选择对NVLINK融合做出反应。但事实是,更多的球员不再对演奏支持论文感到满意。 ASIC的增长不仅是对技术路线的重复,而且是由联盟促进并由生态系统推广的巨人提出的系统挑战。尽管NVIDIA很强大,但面对这样的对手时,它仍然是警惕的。

在峰值下,NVIDIA的三个弱点

当市场价值达到3.92万亿美元时,NVIDIA达到了全球资本市场中最受欢迎的时刻。但是在这个令人眼花的高度下,越来越多的问题开始n表面。从工业希望到产品结构,再到生态学方法,NVIDIA往往会因其创造的成功逻辑而适得其反。

一个是对超大客户的集中期望。 NVIDIA的当前收入来自数据中心业务,大多数集中在少数巨型云计算的手中:Microsoft,AWS,AWS,Alibaba,Meta,Google和Essential OpenAI。 ITO不仅拥有AI本身,而且组成了Ualank联盟的客户,这个人会削弱Nvidia GPU的主导地位。

Google拥有TPU,亚马逊有火车,Meta和Microsoft分别推出了MTIA和MAIA系列加速器。尽管Openai也在尝试Google TPU,但自我开发的AI芯片的消息仍在继续泄漏。这些客户不需要NVIDIA,但不想“仅”依靠Nvidia。

第二个是成本效益。 Blackwell平台几乎带来了Computin的改进G力量,尤其是训练和了解GB200体系结构的性能的跳跃。但与此同时,本一代产品的复杂性,电力消耗以及本一代产品的生产也攀升了。根据汇丰银行的说法,GB200 NVL72服务器的价格为近300万美元,削弱了Marour客户。

GB200 NVL72,图片/NVIDIA

这种设计的最终方法实际上锁定在高端市场上,但它也带来了两种副作用:一个将使中小型客户离开门外,另一个是推动客户寻找更便宜,更替代的节能替代品。当AI推理成为一项主要任务时,成本效益通常比全部性能更重要,这是ASIC这样的专业芯片很棒的地方。

此外,对于云制造商等基本客户,他们愿意在早期阶段支付绩效。但是,随着比例SCA的扩展LE,模型的标准化以及预算的收紧,即使大型制造商越来越希望拥有更多的自主权和沟通空间。当Nvidia变得“需要使用它”时,这意味着工业链开始寻找“不使用它”的选项,而Google TPU的成功却不多。

第三是Nvidia的生态障碍。 NVIDIA CUDA目前是该行业中最强大的AI编程生态系统,但是高水平的关闭也使其逐渐成为一个“属于Nvidia”的世界。在开放生态系统(例如Ualank Alliance,Oneapi和MLIR)的背景下,越来越多的开发人员和系统设计师开始追求跨平台和异质合作,而不是将其命运与公司工具链的命运联系起来。

库达(Cuda)是Nvidia的前护城河,但现在它已成为“生态高墙”,在一定程度上限制了开发人员的自由流动。正如制造商期望的那样为了在不同的建筑之间移动灵活,CUDA屏障也可能导致转弯。

作为回报,NVIDIA仍然是当今AI芯片的最强大制造商,一直处于技术,产品和市场价值的高潮。但是高潮永远不会结束,这是面临更多挑战的唯一起点。更重要的是,NVIDIA不会面临技术更换的风险,而是面临以客户为主导的权力下放的风险。如前所述:Nvidia是世界数字,不稳定。回到Sohu看看更多

几天前,Nvidia再次创造了历史。 7月3日,NVIDIA的市场价值提高了3.92万亿美元,超过了苹果以前的3.915万亿美元记录,该公司已成为具有市场价值的最高历史记录公司。人工智能计算能力的快速增长将这家GPU制造商推向了前所未有的高位。尤其是自2024年底以来,布莱克韦尔的平台销售业绩(既跃升为能源的表现和效率)都打破了世界以外的疑问。 NVIDIA创始人兼首席执行官Huang Renxun在最新的收入电话会议中说,仅在2025年第一季度,这个新平台贡献了NVIDIA数据收入的近70%。但是,随着NVIDIA市场成本及其混合物的增加,生态系统也出现了裂缝。最常见的例子是Nvidia -Openai的重要客户。 Openai Insider引用的信息几乎是NVIDIA市场成本,Openai说Openai使用Google的TPU芯片自由提供计算能力SU SU用于CHATGPT和其他产品的PPORT。 TPU服务器,照片/Google,即使Openai在随后的响应中故意降低了“转向”,并强调这是一项测试,并且“没有很大的收养计划”。但是对于曾经定义新AI时期的公司而言,即使是“测试”也足以触发高市场敏感性。同时,它还使第七代Google,Ironwood再次成为重点。这是一个专用的AI芯片,可定制用于识别场景。它不仅直接指向了布莱克韦尔(Blackwell)的每一个WAT,而且还表现出对成本和扩张费用的强烈吸引力。更重要的是,面对结构性挑战的真正使NVIDIA的原因是ASIC芯片营地,其强调“效率”而不是“通用”。诸如Google,Amazon和Meta之类的巨型云继续增加他们对自发加速器的投资,以避免NVIDIA GPU的高成本;虽然小脑和图形等初创公司re - 从芯片体系结构和系统设计的角度来定义“ AI特异性计算”,试图开发与GPU完全不同的技术路径。对于Nvidia而言,第一世界的宝座是不稳定的。 ASIC攻击成为NVIDIA的“主要问题”,以扩展整个文本

就像俗话说,谁知道一个人的最好的人通常是他的对手。

5月19日,NVLink Fusion是一种新的互连体系结构,被称为“合作平台的AI工程”。通过允许NVLINK芯片间互连(C2C)和模块的集成转移,第三方制造商可以将其自开发的加速器或CPU连接到由计算系统领导的NVIDIA。

与过去的NVLINK设计相比,Fusion的“似乎包括半开放态度,但本质仍然需要合作伙伴附加到NVIDIA Ecology Track。任何定制的芯片都应连接到NVIDIA产品,并且它只选择打开900GB/ 900GB//的界面s nvlink-c2c。 NVLINK融合似乎是表面上的开放态度,这实际上不仅仅是一种防御动作:

防御Ualink联盟。

照片/Ualink联盟

2024年10月,Ualink Alliance Co与AMD,Intel,Google,Meta,Microsoft,AWS,ATBP合作。

今年4月,Ualink发布了1.0标准互连,支持多达1,024个加速器节点,800GBPS带宽互连以及开放的内存 - 仪表协议,而不是仅此通信技术,而是针对“ de-nvidia”的系统布局。 NVIDIA对AI CHIP架构的相互关联比其他任何人都能理解:

真正应得的观看不是特定的制造商,而是整个ASIC营地开始摆脱GPU希望并试图重建硬件订单。

真正应得的观看不是特定的制造商,而是整个ASIC营地开始摆脱GPU希望并试图重建硬件订单。

与GPU的一般体系结构不同,SICS是针对特定活动定制的芯片,在AI期间,它们可以完全优化用于理解,培训和推动等主要计算路径。现在,在Microsoft,Meta和Amazon等巨人中实现了这一概念,并探索了从NVIDIA GPU平台到自我开发的AI ASIC芯片的过渡。

Google是最好的例子,TPU系列自发射以来已经在第七代Ironwood开发了,该系列是为识别任务而设计的,其性能直接超过了NVIDIA Blackwell的每瓦。 Openai研究人员认为,Ironwood的作用与GB200相当,甚至在X平台上稍好一些。更重要的是,TPU系列支持从训练到远见的大型双子座模型的巨大应用大小。

照片/Google

同时,除了其前竞争对手AMD外,包括Meta和AWS在内的MGA新芯片制造商还试图“赶上” Nvidia GPU。基于它的collMeta的第一个AIC芯片MTIA T-V1与Broadcom的灌溉已被宣布有可能超过Nvidia的下一代Rubin芯片的细节。 AWS根据与Marvell的合作推出了另一个版本的Trainiu。 M V3的发展有望在2026年产生质量。

根据野村证券较早发布的最新报告,2025年的Google TPU传输约为150万至200万,AWS Trainium和Phebentia约为140万至150万。到Meta和Microsoft开始大规模部署时,预计它将在2026年首次超过NVIDIA GPU(500万至600万)。

就初创企业而言,脑部是世界上最大的芯片的“独角兽”,它开发了世界上最大的芯片,并用晶圆 - 规模的引擎(WSE)领导了芯片芯片的不断变化的建筑,并在许多科学和科学研究的项目上实施了它。虽然服用GraphCore SOFTbank经历了曲折,它仍然坚持在网络处理(IPU)的体系结构中找到突破。诸如紧张和叛乱之类的新移民继续积累客户,并运送到AI推理和计算边缘等子区域。

世界上最大的芯片,图片/脑脑

Nvidia必须了解这一点,因此她选择对NVLINK融合做出反应。但事实是,更多的球员不再对演奏支持论文感到满意。 ASIC的增长不仅是对技术路线的重复,而且是由联盟促进并由生态系统推广的巨人提出的系统挑战。尽管NVIDIA很强大,但面对这样的对手时,它仍然是警惕的。

在峰值下,NVIDIA的三个弱点

当市场价值达到3.92万亿美元时,NVIDIA达到了全球资本市场中最受欢迎的时刻。但是在这个令人眼花的高度下,越来越多的问题开始n表面。从工业希望到产品结构,再到生态学方法,NVIDIA往往会因其创造的成功逻辑而适得其反。

一个是对超大客户的集中期望。 NVIDIA的当前收入来自数据中心业务,大多数集中在少数巨型云计算的手中:Microsoft,AWS,AWS,Alibaba,Meta,Google和Essential OpenAI。 ITO不仅拥有AI本身,而且组成了Ualank联盟的客户,这个人会削弱Nvidia GPU的主导地位。

Google拥有TPU,亚马逊有火车,Meta和Microsoft分别推出了MTIA和MAIA系列加速器。尽管Openai也在尝试Google TPU,但自我开发的AI芯片的消息仍在继续泄漏。这些客户不需要NVIDIA,但不想“仅”依靠Nvidia。

第二个是成本效益。 Blackwell平台几乎带来了Computin的改进G力量,尤其是训练和了解GB200体系结构的性能的跳跃。但与此同时,本一代产品的复杂性,电力消耗以及本一代产品的生产也攀升了。根据汇丰银行的说法,GB200 NVL72服务器的价格为近300万美元,削弱了Marour客户。

GB200 NVL72,图片/NVIDIA

这种设计的最终方法实际上锁定在高端市场上,但它也带来了两种副作用:一个将使中小型客户离开门外,另一个是推动客户寻找更便宜,更替代的节能替代品。当AI推理成为一项主要任务时,成本效益通常比全部性能更重要,这是ASIC这样的专业芯片很棒的地方。

此外,对于云制造商等基本客户,他们愿意在早期阶段支付绩效。但是,随着比例SCA的扩展LE,模型的标准化以及预算的收紧,即使大型制造商越来越希望拥有更多的自主权和沟通空间。当Nvidia变得“需要使用它”时,这意味着工业链开始寻找“不使用它”的选项,而Google TPU的成功却不多。

第三是Nvidia的生态障碍。 NVIDIA CUDA目前是该行业中最强大的AI编程生态系统,但是高水平的关闭也使其逐渐成为一个“属于Nvidia”的世界。在开放生态系统(例如Ualank Alliance,Oneapi和MLIR)的背景下,越来越多的开发人员和系统设计师开始追求跨平台和异质合作,而不是将其命运与公司工具链的命运联系起来。

库达(Cuda)是Nvidia的前护城河,但现在它已成为“生态高墙”,在一定程度上限制了开发人员的自由流动。正如制造商期望的那样为了在不同的建筑之间移动灵活,CUDA屏障也可能导致转弯。

作为回报,NVIDIA仍然是当今AI芯片的最强大制造商,一直处于技术,产品和市场价值的高潮。但是高潮永远不会结束,这是面临更多挑战的唯一起点。更重要的是,NVIDIA不会面临技术更换的风险,而是面临以客户为主导的权力下放的风险。如前所述:Nvidia是世界数字,不稳定。回到Sohu看看更多

当前网址:https://www.ajitaro.com//a/keji/785.html